Alles eine Frage der Fairness

Neue Poverty Maps von Uganda und...

Weltweit leben über 700 Millionen Menschen in extremer Armut. Dies bedeutet nicht nur Einkommensmangel, sondern auch fehlende Chancen durch begrenzten Bildungszugang, soziale Ausgrenzung und fehlende Mitbestimmung. Der Kampf gegen Armut ist das wichtigste Ziel der Vereinten Nationen für eine nachhaltige Zukunft.

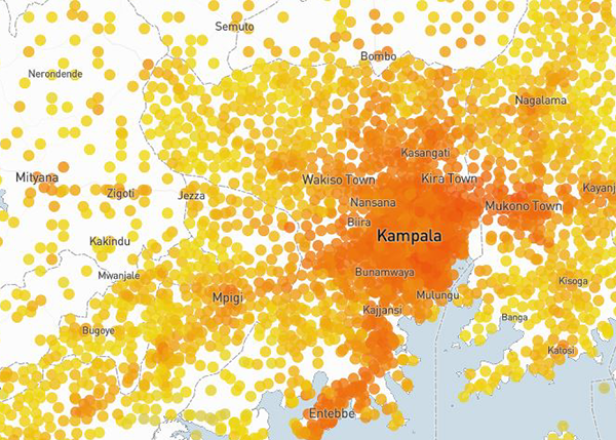

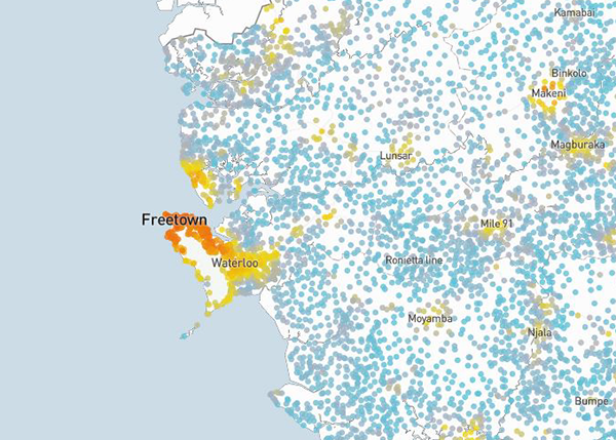

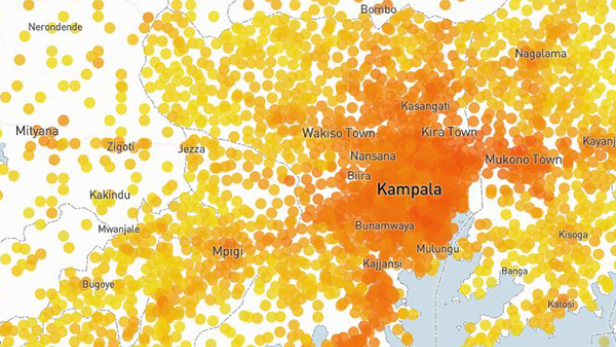

„Bevor man Armut beseitigen kann, muss man wissen, wo Menschen besonders arm sind“, sagt Lisette Espin-Noboa, PostDoc, Komplexitätsforscherin an der Central European University (CEU) und am Complexity Science Hub (CSH), einem Wiener Forschungsinstitut mit dem Ziel, aus großen Datenmengen gesellschaftlich relevantes Wissen zu generieren. Gemeinsam mit anderen Wissenschafter*innen entwickelte sie eine neue, viel genauere Form der sogenannten Poverty Maps (deutsch: Armutslandkarten) für die afrikanischen Länder Sierra Leone und Uganda. Poverty Maps sind datenbasierte Karten, die die Verteilung von Armut über ein geografisches Gebiet hinweg zeigen.

„Sie sind wichtige Werkzeuge, die uns helfen, diese Orte zu identifizieren, damit Regierungen oder NGOs fundierte Entscheidungen treffen und gezielt intervenieren können“, sagt Espin-Noboa. Um die Genauigkeit der Karten zu verbessern, suchte das Team nach passenden Daten, die in den Algorithmus einfließen können. „Wir hatten drei Zutaten: Zum einen Ground-Truth-Daten – das sind Umfragen, die fragenbasierte Angaben über Vermögenswerte, wie viele Räume das Haus hat, die Wasserqualität usw. enthalten. Außerdem brauchten wir Merkmale, die der künstlichen Intelligenz (KI) helfen, Muster zu lernen, um später zwischen Arm und Reich unterscheiden zu können, und natürlich die KI selbst“, so Espin-Noboa.

Bevor man Armut beseitigen kann, muss man wissen, wo Menschen besonders arm sind

Algorithmic Fairness

Je besser die Daten, desto fairer kann die KI arbeiten. Denn Fairness ist auch bei der KI-Entwicklung ein wichtiger Punkt. Espin-Noboa untersucht genau das. Ihr Spezialgebiet ist „Algorithmic Fairness“, also das Sicherstellen, dass maschinelles Lernen oder KI-Systeme fair, bzw. gerecht sind. „Wir sind immer mehr auf Algorithmen angewiesen. Wenn sie nicht fair sind, sind wir es auch nicht. Wenn Algorithmen nur der Mehrheit nutzen, drängen wir Minderheiten an den Rand der Gesellschaft. Die Geschichte hat gezeigt, dass das negative Konsequenzen haben kann“, sagt die Expertin.

Um Fairness zu garantieren, müssen wir auch an uns arbeiten: „Ich finde Widersprüche zwischen dem, was die Leute sagen, und dem, was sie tun. Das sollten wir ändern. Man kann nicht lautstark fordern, dass Systeme fair sind, wenn Menschen etwa unfair zu Mitarbeitenden, Kolleg*innen, Nachbar*innen, Ausländer*innen sind – ich finde diese Inkongruenzen überall, und sie stören mich.“ Und weiter: „Diejenigen, die KI besitzen oder betreiben, sollten verantwortlich und rechenschaftspflichtig sein.“ Letzten Endes geht die Fairness von Maschinen eben noch von uns Menschen aus.