Hass im Netz: Warum extreme Inhalte so erfolgreich sind

Hass im Netz ist längst Alltag: Ein erheblicher Teil der Menschen in Österreich kommt online mit beleidigenden oder herab-würdigenden Inhalten in Kontakt. Besonders häufig tritt das auf Social Media und unter Jüngeren auf. Was bedeutet das für öffentliche Debatten und demokratische Teilhabe?

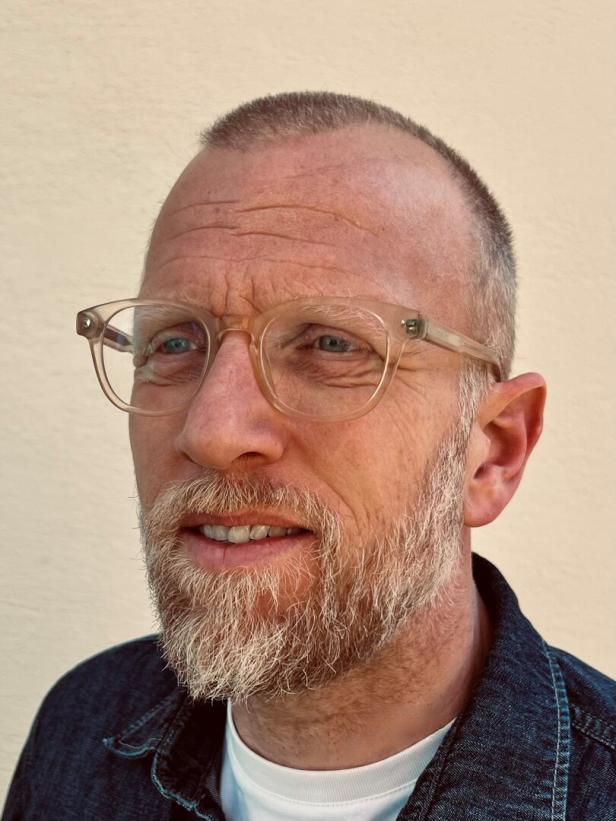

Prof. Hajo Boomgaarden vom Institut für Kommunikationswissenschaft der Universität Wien erklärt, welche Dynamiken dahinterstehen und wo Handlungsbedarf besteht.

Soziale Netzwerke galten lange als Motor demokratischer Teilhabe. Heute werden sie oft als Brandbeschleuniger für Polarisierung, Hass und Fake News beschrieben. Wo stehen wir aktuell?

Hajo Boomgaarden: Soziale Netzwerke waren lange mit großen demokratischen Hoffnungen verbunden, etwa mehr Teilhabe, direkter Kommunikation und neuen Gegenöffentlichkeiten. Heute rücken jedoch problematische Aspekte wie Polarisierung, Desinformation und enthemmte Kommunikation stärker in den Vordergrund, auch wenn Forschung keine flächendeckenden Echokammern belegt und soziale Medien nicht immer der Hauptkanal für Desinformation sind. Grundsätzlich liegt das Problem weniger in den Plattformen selbst als in ihrer auf Aufmerksamkeit und Gewinn ausgerichteten Gestaltung, die demokratieschädliche Dynamiken begünstigen kann.

In einem Beitrag 2022 schrieben Sie: „Demokratie braucht eine neue Vision sozialer Medien.“ Was meinen Sie damit?

Soziale Medien sollten nicht primär nach Wachstum, Reichweite und Werbeerlösen gestaltet werden, sondern im Sinne eines Digitalen Humanismus auch demokratische und humane Werte fördern. Eine neue Vision würde Plattformen als Infrastruktur demokratischer Öffentlichkeit verstehen und Prinzipien wie Transparenz, Fairness, Inklusion und Schutz vor Einschüchterung ins Design integrieren. Dafür braucht es unter anderem mehr Kontrolle für Nutzer*innen, transparente Algorithmen, verlässliche Informationen sowie Regulierung, da freiwillige Maßnahmen meist nicht ausreichen.

Welche Folgen hat Hass im Netz für die Gesellschaft?

Hass führt häufig dazu, dass sich Menschen aus öffentlichen Debatten zurückziehen. Das verengt das sichtbare Meinungsspektrum und benachteiligt insbesondere Minderheiten, Frauen oder Journalist*innen. Dadurch wird Öffentlichkeit ungleicher, und es verschieben sich die Grenzen des Sagbaren.

Wie hängen Hass und Desinformation zusammen?

Beides sind unterschiedliche Phänomene, haben aber gemeinsame Ursachen in Plattformlogiken. Sie können sich gegenseitig verstärken: Desinformation liefert Narrative, aus denen Hass entsteht, während Hass Inhalte emotionalisiert und verbreitet. Darunter leidet aber die Qualität öffentlicher Diskurse.

Soziale Medien sollten nicht nach Wachstum, Reichweite und Werbeerlösen gestaltet werden.“

Warum verbreiten sich extreme Inhalte so schnell?

Weil sie emotionalisieren, einfacher formuliert sind und mehr Interaktion auslösen. Plattformen verstärken diese Dynamiken durch ihre auf Engagement ausgelegten Systeme. Sachliche Inhalte haben es strukturell schwerer.

In Österreich gilt seit 2021 das „Hass im Netz“-Bekämpfungsgesetz, auf EU-Ebene seit 2024 der Digital Services Act. Wie wirken diese Maßnahmen und wo muss man nachschärfen?

Sie markieren einen wichtigen Schritt, weil Plattformen stärker in die Verantwortung genommen werden. Es gibt Fortschritte bei Moderation und Rechtsdurchsetzung, aber auch weiterhin Defizite, etwa bei der Umsetzung und bei systemischen Problemen. Vor allem die grundlegenden algorithmischen und ökonomischen Logiken bleiben weitgehend unangetastet.

Was ist das Projekt „WHAT-IF-Machine“?

Ein europäisches Forschungsprojekt mit Teilnahme der Universität Wien, das Kommunikation in sozialen Medien mithilfe von Simulationen abbildet, um Auswirkungen von Regulierungen oder Eingriffen in Plattformsysteme zu testen. Ziel ist eine Art „digitaler Zwilling“ der Informationsumgebung, um Maßnahmen vorab unter kontrollierten Bedingungen zu prüfen.

Wenn man politische Kommunikation simuliert – besteht dann nicht auch die Gefahr, gesellschaftliche Dynamiken zu stark zu vereinfachen oder falsch abzubilden?

Ja, diese Gefahr besteht grundsätzlich. Simulationen vereinfachen Realität, daher ist kontinuierliche Validierung wichtig. Sie sind kein Orakel, sondern ein Werkzeug, um Mechanismen sichtbar zu machen und Entscheidungen besser zu fundieren.

Welche Rolle spielt Medienkompetenz heute – auch im Hinblick auf die Entwicklungen im KI-Bereich?

Sie bleibt zentral, wird aber im KI-Zeitalter anspruchsvoller. Entscheidend ist die Fähigkeit, Inhalte kritisch zu prüfen, Quellen einzuordnen und bewusst zu reflektieren, statt alles sofort zu glauben oder weiterzuverbreiten.

Wenn Sie soziale Medien völlig neu gestalten könnten: Welche Elemente müsste eine Plattform haben, damit sie demokratische Debatten stärkt, statt Polarisierung zu fördern?

Sie würde Inhalte breiter streuen, statt nur bestehende Präferenzen zu verstärken, und reflektierte Auseinandersetzung belohnen. Transparenz, Kontext, Sichtbarkeit von Qualitätsinformation und Schutzmechanismen für Betroffene wären zentral. Ziel wäre ein Design, das Teilhabe und Pluralität stärkt statt bloß Aufmerksamkeit zu maximieren.

Kommentare